Informationstheorie ist, wenn man den uebichen Quellen glaubt, eine Mischung aus angewandter Mathematik, Nachrichtentechnik und Informatik und beschaeftigt sich hauptsaechlich mit der Quantifizierung, Speicherung und Uebertragung von Information. Die klassischen Teilgebiete der Informationstheorie sind

- Kanalkodierung: Auch im tiefsten Wald und bei Regen kommt das Cache-Listing korrekt auf eurem Smartphone an.

- Quellkodierung: Euer Fotolog benoetigt weniger Speicherplatz im JPEG-Format als das selbe Bitmap

- Kodierung fuer Speichermedien: CDs funktionieren auch noch mit kleinen Kratzern

- "Shannon-Theorie": Ist der Handy-Empfang im Wald schlecht, dauert es laenger bis das Listing geladen ist, oder, wieviel Bits bekomme ich pro Sekunde ueber den (Funk-)Kanal?

- Informationssicherheit: Euer GC-Account kann nicht leicht gehackt werden.

Daneben haben sich die Methoden und Messgroessen der Informationstheorie in vielen anderen wissenschaftlichen Disziplinen breit gemacht, unter anderem Signalverarbeitung, Sprachanalyse, Biologie (DNA Analyse und Kodierung), Physik, maschinelles Lernen und Mustererkennung.

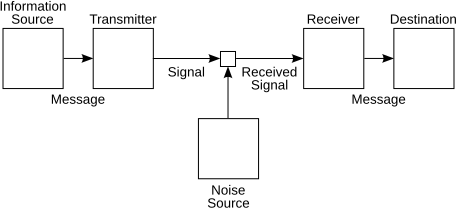

Es ist beeindruckend, dass das gesamte Wissenschaftsgebiet auf sehr wenigen Arbeiten aufbaut, wovon die meisten Claude E. Shannon geschrieben hat. Die wohl wichtigste davon ist sicher "A Mathematical Theory of Communication", die im jahr 1948 im Bell System Technical Journal veroeffentlicht wurde und inzwischen ueber 75.000 mal zitiert wurde. In dieser Arbeit definiert Shannon Entropie und Transinformation, zwei Groessen die bald darauf ihren Siegeszug als Masse fuer die Information eines Signals antraten. Diese Arbeit enthaelt auch Beitraege zur Kanalkodierung, verlustfreien und verlustbehafteten Quellkodierung, Kapazitaetsanalysen von Kanaelen und sogar Anwendungen auf linguistische Modelle sind vorhanden -- alles aus der Feder eines einzelnen Mannes!

In English, please!

According to the usual sources, information theory is a mix between applied math, communications engineering, and computer science. It deals with quantifying, storage, and transmission of information. The classic sub-disciplines of information theory are:

- Channel coding: Even in the deepest forest and heavy rain, this listing is loaded correctly on your smartphone.

- Source coding: Your photolog requires less memory than the bitmap if saved as a JPEG file.

- Coding for storage media: CDs still play, even though there are tiny scratches.

- "Shannon theory": If reception is low, it takes longer to load the listing, or, how many bits can I transmit over the channel per second?

- Information Secrecy/Security: It's hard to hack your GC account.

In addition, the methods and measures from information theory have made their way into many scientific disciplines, such as signal processing, speech analysis, biology (DNS sequencing and coding), physics, machine learning, and pattern recognition.

It is remarkable that the whole discipline builds on very few works, most of which were written by Claude E. Shannon. Probably the most important one is his "A Mathematical Theory of Communication", published 1948 in the Bell System Technical Journal and cited more than 75.000 times since. In this work, Shannon defines entropy and mutual information, two quantities that soon became the prevalent measures for the information contained in a signal. This work even deals with problems from channel coding, lossy and lossless source coding, capacity analyses of communication channels, and even an application in natural language processing - all written by a single man!